Undermind

Undermind,一款AI驱动的学术研究工具,通过模仿人类系统性发现过程,帮助研究者快速精准地找到复杂学术问题的答案

标签:学术工具 文献检索 科研实用工具Undermind Undermind官网 Undermind官网入口undermind官网:AI科研助手,自主多步搜索、智能信息综合、深度推理分析、研究报告生成,帮助研究者进行复杂课题的系统性调研

什么是undermind?

Undermind是一款由MIT博士团队开发、Y Combinator孵化的AI科研助手,定位为”智能深度研究伙伴”。该平台通过AI驱动的搜索技术,阅读数千篇论文并评估其重要性,发现跨学科的创新连接,将传统需要数周的文献调研工作缩短至几分钟。核心优势在于引用图谱遍历和全文分析,系统不仅检索关键词,更理解研究问题的语义和上下文,返回精准相关的学术资源。平台被MIT、哈佛、加州理工等顶尖机构信赖,提供相关性评分、新颖性评估和跨学科洞察,帮助研究人员、学生和团队快速建立领域认知框架,是当代科研工作者提升文献综述效率的必备利器。

undermind官网: https://www.undermind.ai/

Undermind深度评测:模拟人类搜索逻辑的学术AI,迭代式文献挖掘的极致体验

学术文献搜索有一个长期未被解决的根本性问题:你不知道自己不知道什么。

用关键词在Google Scholar搜索,结果排序依赖引用量和关键词命中,遗漏的往往是那些表述方式与你不同但内容高度相关的文献。用语义搜索,系统理解你的意图,但通常执行一次搜索就结束,覆盖率存在天花板。用引用网络追踪,能找到关联文献,但方向性强、边界模糊,系统性差。

没有一种搜索方式能保证你找到了”所有重要文献”——而在系统综述和大型研究项目中,遗漏关键文献可能是方法论层面的根本性缺陷。

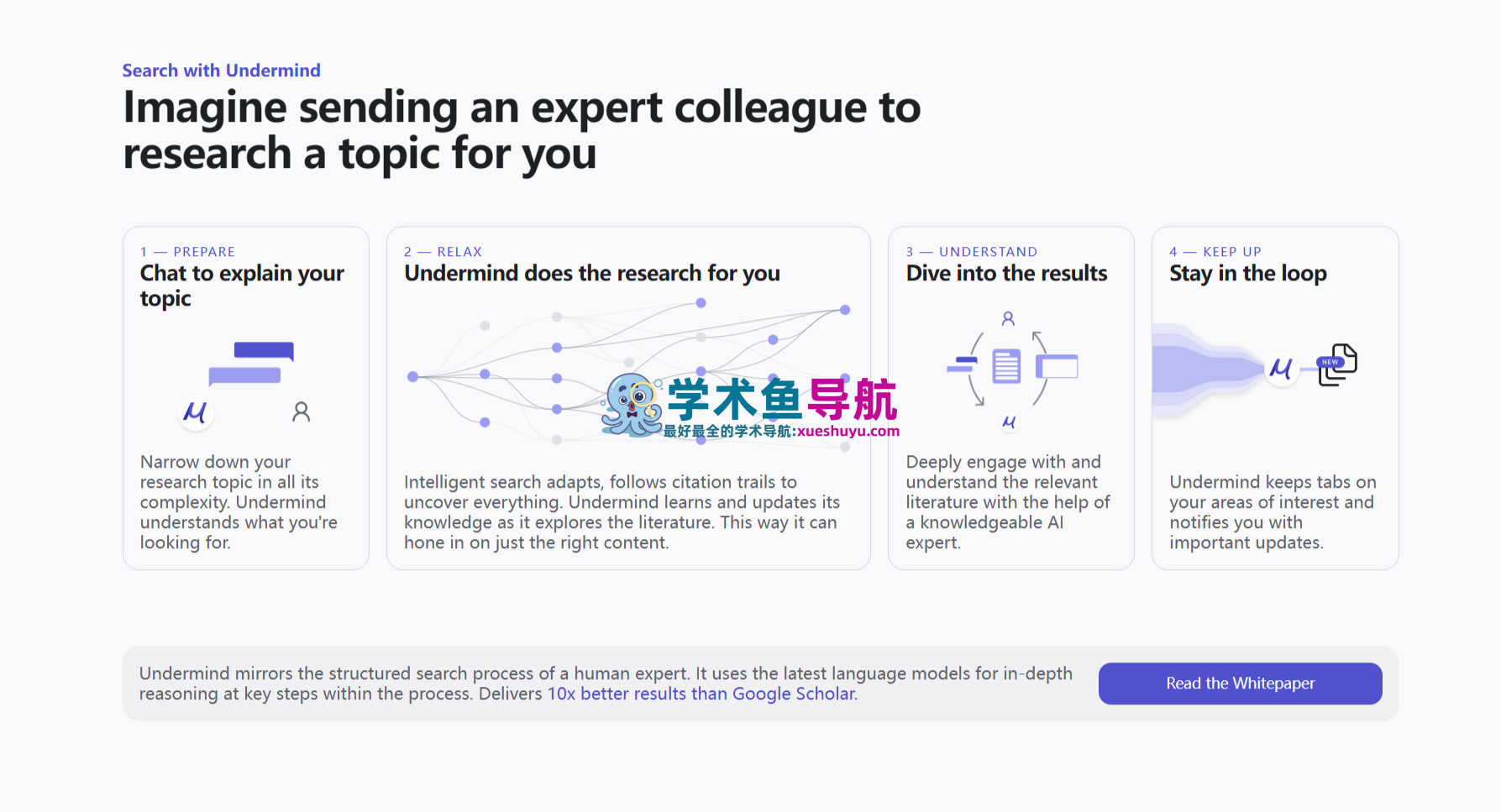

Undermind想解决的正是这个问题。它的核心逻辑不是”更好地回答你的搜索请求”,而是”像一个资深研究者那样主动展开搜索”——先找到一批初步相关文献,分析它们,然后根据发现自动调整搜索策略,继续追踪,再分析,再调整,循环迭代,直到覆盖率趋于饱和。这个过程不需要用户的持续参与,Undermind自主完成。

背景:一家小团队做的硬核搜索引擎

Undermind是一家专注于AI驱动深度学术搜索的初创公司,团队规模不大但技术导向极强。产品从一开始就定位于”严肃的学术研究者”——不是入门学生,不是偶尔查阅文献的从业者,而是那些需要系统性、全面性地覆盖某一研究方向的科学家、医学研究者和专业分析师。

与Elicit(Ought公司旗下、有明确AI安全研究背景)和Consensus(由风险投资驱动快速增长)不同,Undermind的公司风格更接近”工具研究者做的研究工具”——官网有完整的技术白皮书公开发布,详细描述搜索算法的四个步骤和召回率基准测试数据;学术图书馆社区对它的评测频率相当高,在新加坡管理大学、不列颠哥伦比亚大学、华盛顿州立大学等机构的正式AI工具评估项目中均有出现。

这种学术机构级别的正式采购评估,是大多数消费者向AI工具不会经历的验证流程,也是Undermind在专业研究者群体中建立信任的核心渠道。

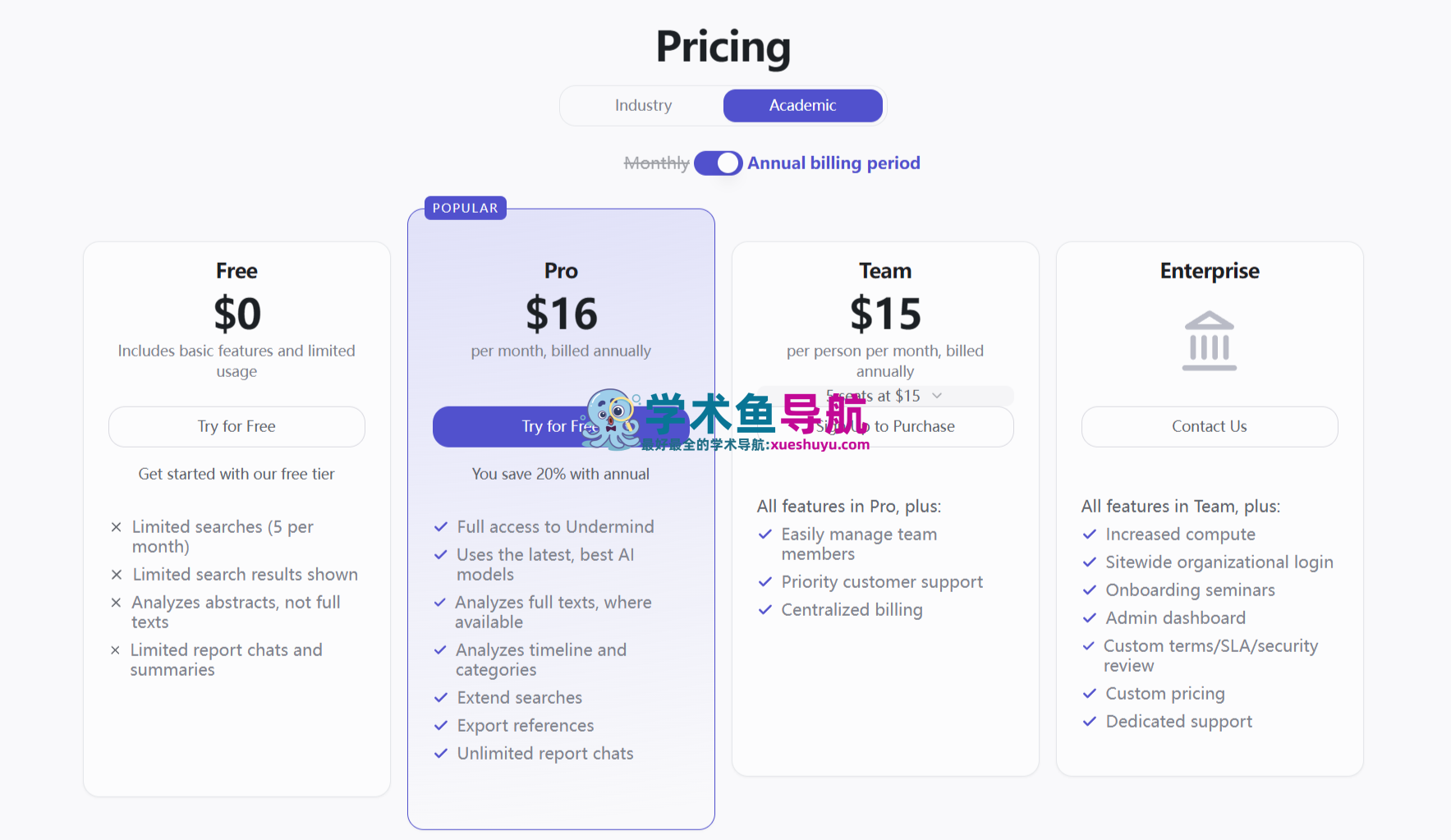

定价方案:层级清晰,专业定位

Undermind的定价结构在同类工具中相对透明:

Free(免费版):完全免费,可以体验基础搜索和报告功能,每月有限量的深度搜索额度。适合首次体验和低频使用场景,免费版的功能足以让用户感受到迭代式搜索的核心体验。

Pro(专业版):每月16美元(年付,节省20%),或月付更高。包含:完整的深度迭代搜索、最新最优AI模型(基于GPT-4级别的语言模型)、可用时的全文分析(Full-text analysis)、时间线与类别分析、搜索扩展(Extend searches)、引用导出、无限次报告对话(Unlimited report chats)。16美元/月是目前同类专业AI学术工具中最低的年付Pro定价之一——Elicit Pro为49美元/月,Scite Plus为10美元/月但功能更单一,Consensus Premium约10美元/月。

Team(团队版):每人每月15美元(年付),比Pro版单人稍低,包含Pro的全部功能,加上团队协作功能和集中账户管理。面向课题组、研究部门或企业研发团队。

Enterprise(企业版):定价面议,提供无限使用量、专属支持、SLA服务级别协议和自定义集成,适合大型机构。

年付Pro折算下来每年约192美元,在付费学术AI工具中是明显偏低的价格,这对于任何有较高频度系统性文献搜索需求的研究者来说,几乎没有经济障碍。

核心功能深度解析

迭代式AI搜索:Undermind的技术心脏

理解Undermind的一切,从理解它的搜索算法开始。Undermind在其公开发布的技术白皮书中,将搜索过程分解为四个步骤:

步骤一:初始候选文献识别(Basic Search)

系统收到用户的研究问题后,首先执行混合搜索——将语义向量嵌入(semantic vector embeddings)、引用关系数据和语言模型推理三者结合,从Semantic Scholar超过2亿篇文献的数据库中识别初步候选文献。这不是单一的语义搜索,而是三种方法的组合,初步候选集合通常覆盖数百篇文献。

步骤二:相关性分类(Relevance Classification)

对初步候选文献,系统调用GPT-4级别的高质量语言模型,依照用户的原始搜索问题,对每篇文献进行三级相关性评估:高度相关、部分相关、不相关。这个分类过程不是简单的关键词匹配,而是真正理解文献内容与研究问题之间的语义关系,能够识别那些用不同术语表达相同概念的文献。有条件时(Open Access全文可获取),系统会读取全文而非仅依赖摘要进行判断,准确性进一步提升。

步骤三:自适应搜索策略调整(Adaptive Search Refinement)

这是Undermind与其他工具最根本的区别所在。系统分析第一轮找到的高度相关文献,从中提取新的概念框架、专业术语变体和引用关系,自动调整下一轮搜索策略——包括生成新的关键词组合、识别重要引文以进行前向和后向追踪,以及发现初始搜索策略未覆盖的相关子领域。然后执行第二轮搜索,再分析,再调整,如此循环迭代。

一个具体的技术参数能说明这个过程的深度:在有据可查的测试案例中,Undermind平均分析约150篇文献(部分深度搜索可达数百篇),而同类工具Consensus的深度模式最多分析50篇。这个量级差异直接反映在召回率上。

步骤四:覆盖率统计与收敛判断(Coverage Estimation)

这是Undermind提供的一个独特的元信息层:系统在搜索过程中持续估算”在这个主题上,相关文献的总量大约是多少,我目前已找到其中多少比例”。当覆盖率估算值趋于饱和(通常在85-95%)时,系统认为搜索已足够完整,给出报告。用户也可以在任意阶段触发”扩展搜索(Extend search)”,让系统继续深挖。

这个覆盖率估算是Undermind最具争议的功能之一——支持者认为它提供了其他工具没有的搜索完整度量化,批评者指出这个估算缺乏独立验证,方法论尚不透明。但它作为”搜索何时可以停止”的判断辅助,在实践中有真实的参考价值。

整个搜索过程通常需要2-5分钟(深度搜索可能更长),在操作上意味着用户不是在等待一个即时结果,而是把一个搜索任务”交给”Undermind去执行,中间可以去做别的事情。

自然语言查询界面:像向同事解释一样输入搜索问题

Undermind的搜索入口设计基于一个简单但深刻的洞察:学术搜索的真实难点,不是技术上的关键词组合构建,而是如何把一个复杂的研究问题转化成有效的检索策略。

传统搜索要求用户把研究问题”翻译”成关键词+布尔逻辑的组合,这个翻译过程本身就是一个需要专业知识的任务,往往是非专业用户搜索效果差的根本原因。Undermind彻底绕过了这个翻译过程:它鼓励用户以自然语言详细描述研究问题,就像在向一位博士导师或学科馆员解释自己的研究方向一样。

典型输入示例:

-

不推荐:”mRNA vaccine elderly immune response”

-

推荐:”我在研究mRNA疫苗在65岁以上老年人群中的免疫原性表现,特别关注CD4+ T细胞应答的幅度差异,以及这些差异与年龄相关免疫衰老机制的关系。我希望找到2019年至今发表的临床研究和机制研究。”

系统会在搜索开始前通过内置对话框进一步询问补充信息,类似学术图书馆的”参考咨询访谈”(Reference Interview)——这个设计被多位学术图书馆员在评测中特别点名称赞,认为它体现了专业信息检索的服务逻辑。

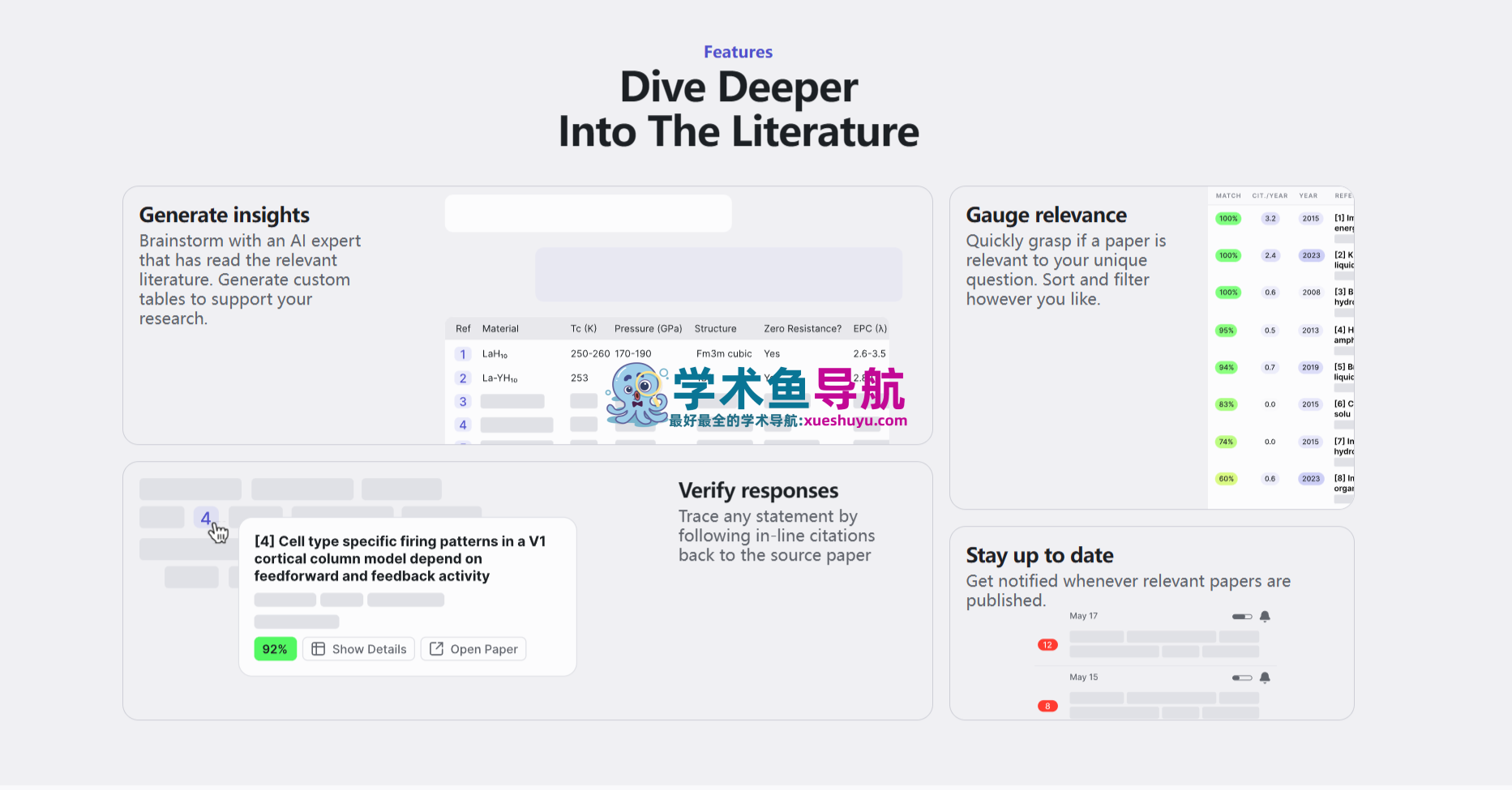

搜索报告(Research Report):结构化、有来源、可对话

Undermind将每次搜索结果整理为一份完整的结构化研究报告,而不只是一个文献列表。

报告格式通常包括:

-

执行摘要:该主题的研究现状概述,包含主要发现和研究走向

-

主要发现(Key Findings):以条目形式列出最重要的研究结论,每个条目附有具体文献引用

-

文献列表:按相关性排序的完整文献清单,包含标题、作者、年份、摘要和相关性说明

-

时间线分析(Timeline Analysis):该主题研究的历史演进,识别关键节点和研究方向的演变

-

类别分析(Category Analysis):将找到的文献按研究类型、方法论或子主题分类,帮助用户快速理解领域结构

-

覆盖率估算:已找到的文献占预估总体的百分比

报告的语言风格是条目式的(bullet-point format),而非连续段落文字,这是被用户和图书馆员反复提及的实用设计——条目格式方便快速扫描,提取关键信息的效率高于长篇叙述段落。在学术图书馆员的对比评测中,Undermind的报告格式在”易扫描性”维度上优于Consensus的叙述段落风格。

无限次报告对话(Unlimited Report Chats)

生成报告后,用户可以在报告界面内直接与AI进行追问对话,所有对话都在报告的内容范围内进行,AI的回答基于已找到的文献,不会引入外部幻觉信息。

可以追问的问题类型包括:

-

“这些研究中,有多少是随机对照试验?”

-

“有没有文献专门讨论儿童人群中的表现?”

-

“这个领域最大的研究争议是什么?”

-

“帮我把这15篇高度相关的文献按方法论分类”

对话生成的回答同样附有文献引用,所有陈述都可以追溯到具体来源。无限次对话这一设计(Pro版)意味着用户可以充分挖掘一次搜索的信息密度,不用担心对话次数耗尽后的功能受限。

引用导出(Export References)

搜索报告中的所有文献可以导出为多种标准格式,包括BibTeX、RIS等主流文献管理格式,方便直接导入Zotero、Mendeley或EndNote进行后续管理。

导出时可以选择仅导出高度相关文献、所有相关文献,或完整的候选列表,满足从精选到全量的不同需求。这个功能将Undermind的发现结果无缝接入现有的文献管理工作流,是将搜索工具与管理工具打通的关键桥梁。

搜索提醒(Search Alerts):高质量的”邻域感知”

基于已创建的搜索报告,用户可以设置持续监控提醒——当新发表的文献出现在该研究方向的相关范围内时,系统自动发送邮件提醒。

Undermind的提醒系统有一个被用户特别称道的特性:邻域提醒(Adjacent Alerts)。除了直接匹配搜索主题的新文献之外,系统还会推送与主题相关但不完全在定义范围内的”邻域”研究——比如,你的搜索主题是”CRISPR基因编辑在遗传性耳聋中的应用”,邻域提醒可能会推送”CRISPR在其他感官系统遗传疾病中的新进展”,这些文献可能不直接匹配你的主题,但对于了解领域的更广泛走向有价值。

在学术图书馆的评测报告中,Undermind的提醒质量被评为”极高(extremely high quality and useful)”,邻域提醒功能被明确点名为优于同类工具Consensus(后者目前没有类似功能)的特色设计。

全文分析(Full-text Analysis)

当文献以Open Access形式公开全文时,Undermind不仅读取摘要,还会读取全文进行相关性判断。这个功能在同类工具中不普遍——大多数工具依赖标题和摘要。

全文分析的意义在于:很多文献的核心贡献在正文的方法论、数据或讨论部分,摘要的表述有时不能完全反映文章与特定研究问题的关联程度。全文分析让系统能够发现那些”摘要看起来不那么相关,但正文确实包含高度相关内容”的文献,提升召回率的同时也改善了排序精准度。

时间线与类别分析

时间线分析将找到的文献按发表时间排列,配合AI的阶段性描述,帮助研究者理解一个领域的历史演进——哪些是奠基性的早期研究,哪些是推动范式转移的关键节点,近年的研究走向是什么。

类别分析将文献按研究方法、研究子题或研究类型自动分组,让用户在面对数十到数百篇文献时,不是从一个单一的无序列表开始阅读,而是已经有了一个初步的文献结构图。这两个分析都包含在标准搜索报告中,不需要额外操作。

实测评价:把优势和局限讲清楚

真实好用的地方:

召回率是Undermind最核心的竞争优势,有独立数据支撑。在不列颠哥伦比亚大学的评测研究和新加坡管理大学的对比测试中,Undermind的文献召回率(recall@10和recall@50)在多个测试主题上超过了同类工具和传统学术搜索引擎。对于需要”不遗漏重要文献”的系统综述场景,这个优势是可量化、可验证的,不只是定性描述。

平均分析150+篇文献的深度远超竞品。相比Consensus深度模式最多处理50篇的上限,Undermind在单次搜索的文献分析量级上有3倍差距,这直接决定了搜索的覆盖面。

报告的条目格式极大提升了信息扫描效率。在需要快速建立领域全貌的场景(如开题准备、新方向探索),条目式报告的阅读效率比段落叙述快得多,用户反馈一致性很高。

邻域提醒功能的设计哲学精准:研究者往往不知道自己应该关注哪些邻域方向,主动推送邻域信息把”已知的未知”扩展为”已知的已知”,这种主动信息推送设计在同类工具中找不到直接对标。

定价对应质量比出色。Pro版16美元/月的年付定价,在同类工具中提供了最深的搜索覆盖能力,性价比论据充分。

需要正视的问题:

没有数据结构化提取功能。这是与Elicit最核心的差距——Undermind能找到文献,但不能从找到的文献中提取”样本量是多少”、”干预措施是什么”这类结构化字段。在系统综述的数据提取阶段,Undermind必须与Elicit或人工操作配合,不能独立完成全流程。

没有文献可视化功能。没有Litmaps式的引用网络图谱,文献关系的直观呈现维度不及可视化工具,对于需要理解文献关系网络的探索性阶段,Undermind的呈现方式相对线性。

对中文文献的覆盖接近零。数据库基于Semantic Scholar和部分English-first的开放数据源,中文学术文献系统性地缺席。对以中文文献为主要研究资源的学者,这是根本性的适用性障碍。

搜索速度不适合即时决策。2-5分钟的搜索等待时间,与Google Scholar或Semantic Scholar的即时搜索体验有明显差距。Undermind更适合有时间投入的系统性搜索任务,不适合快速查阅和验证单篇文献的即时场景。

覆盖率估算方法缺乏独立验证。”已找到89.7%的相关文献”这类数据看起来精确,但其背后的统计模型没有经过独立第三方的严格验证,不应该被当作客观事实,而应被理解为方向性参考。

非生物医学领域的表现不稳定。在人文社科、历史学、法学等学科的测试中,Undermind的表现弱于生命科学和计算机科学领域,部分原因是Semantic Scholar数据库在这些领域的文献收录本身就有偏差。

用户界面对新手不够友好。与Consensus的即开即用体验相比,Undermind的界面设计偏向功能性而非引导性,对于没有系统综述经验的用户,正确构建深度研究问题并解读报告需要一定的学习过程。

5款同类工具横向精讲

1. Elicit

Elicit是在系统综述全流程方向最成熟的竞品,与Undermind代表了学术AI工具赛道中互补的两种核心能力路径。

核心优势: 结构化数据提取(Data Extraction)是所有工具中最强的——用自然语言定义提取字段,自动批量处理数百篇文献,每个字段附原文引用来源;系统综述全流程工作流(PRISMA框架覆盖)是唯一能端到端支持正式系统综述的工具;SPLADE语义搜索的准确率高;覆盖Semantic Scholar + PubMed + OpenAlex,来源比Undermind更多元;2026年4月正式推出的Systematic Review专项功能是完整系统综述解决方案。

核心劣势: 搜索是单轮语义搜索,没有Undermind的迭代自适应逻辑,在召回率上理论下限低于Undermind;Pro版49美元/月的定价是Undermind的3倍;没有搜索提醒功能;没有文献可视化。

与Undermind的关键差异: Undermind解决”找到所有重要文献”的召回率问题,Elicit解决”从找到的文献中系统性提取结构化证据”的问题。最佳实践是顺序使用:Undermind做全覆盖搜索,Elicit做数据提取分析。单独使用任何一个,都有明显短板;组合使用,覆盖了系统综述从检索到分析的完整链条。

定价参考: Free版每月有限,Pro版49美元/月,Scale版169美元/月。

2. Consensus

Consensus是定位最宽泛、用户门槛最低的AI学术工具,以”共识度量化”为独特标签,在非专业研究者和本科生中渗透率最高。

核心优势: Consensus Meter(研究共识度量化)是独家功能,以Yes/No/Possibly形式给出该领域研究结论的共识程度,适合快速获取一个问题的科学界总体立场;界面简洁、上手零门槛,是五款工具中最适合非专业研究者的;Copilot搜索模式深度类似Undermind但更快;支持按期刊质量预过滤(排除预印本或限定高影响力期刊),是Undermind不具备的筛选功能;Price约10美元/月,低于Undermind。

核心劣势: 深度模式最多分析50篇文献,与Undermind的150+有明显差距;没有自适应迭代搜索逻辑;没有搜索提醒功能;没有结构化数据提取;报告格式为段落叙述,扫描效率低于Undermind的条目格式;对高度技术性的专业研究问题,共识度量化有时过于简化,可能误导专业判断。

与Undermind的关键差异: 面向用户的层次不同。Consensus更适合本科生、政策研究者和需要快速获取科学共识判断的非专业读者;Undermind更适合需要系统性覆盖文献的博士级研究者和专业科学家。在学术图书馆评测中,这两者被明确定位为”Consensus适合初级用户,Undermind适合高级用户”。

定价参考: 免费版每天10次搜索,Premium约10美元/月。

3. Semantic Scholar

Semantic Scholar是艾伦AI研究所运营的开放学术数据库,完全免费,覆盖超过2.2亿篇论文,是Undermind底层数据的主要来源,也是很多研究者的基础搜索入口。

核心优势: 完全免费,没有任何付费功能;文献覆盖量超过任何商业工具;TLDR功能为每篇文献提供AI生成的单句核心结论;Semantic Reader支持在线阅读PDF并查看内联引用信息;Paper With Code集成对AI/ML研究者有独特价值;支持研究方向主题订阅提醒;数据质量和更新频率是所有学术数据库中最可信赖的来源之一。

核心劣势: 是标准的单次搜索界面,没有迭代自适应逻辑;没有结构化数据提取;没有可视化文献地图;搜索策略完全由用户掌控,没有AI代理辅助;界面功能接近传统数据库,不提供综合性研究报告。

与Undermind的关键差异: Semantic Scholar是Undermind的”数据层”——Undermind的搜索结果来自Semantic Scholar的数据库。这意味着Undermind的文献覆盖上限由Semantic Scholar决定,而Undermind的价值是在这个数据层之上的AI搜索策略层。对于预算有限的用户,Semantic Scholar是零成本的基础工具;对于需要全覆盖系统性搜索的研究者,Undermind在Semantic Scholar的数据基础上提供了质的效率提升。

定价参考: 完全免费。

4. Scite

Scite以”Smart Citations”(智能引用分类)建立独特定位,提供所有同类工具中唯一的引用质量判断维度:追踪一篇文献是被后续研究支持(supporting)、挑战(contrasting)还是仅被提及(mentioning)。

核心优势: 引用质量分析维度在所有工具中独一无二;Reference Check功能可以扫描稿件,识别已被推翻的引用;覆盖超过12亿条带分类标注的引用陈述;对生物医学文献的深度覆盖在同类中最好;在华盛顿州立大学、新加坡管理大学等机构的同期AI工具评估项目中与Undermind并列进行采购评估,说明两者在机构采购层面被视为互补工具。

核心劣势: 没有迭代式文献发现功能;没有结构化数据提取;没有可视化图谱;数据库对非医学领域的覆盖率明显偏低;搜索结果的召回率竞争力不及Undermind;免费版功能受限严重;约120美元/年的定价相对其功能单一性偏高。

与Undermind的关键差异: 两者在研究流程中服务于不同的质量控制维度——Undermind确保文献发现的完整性(找全),Scite确保已找文献的证据可靠性(找准)。在系统综述项目中,Undermind做搜索覆盖,Scite做引用质量复核,是明确的流程顺序互补关系。

定价参考: 免费版有限,Plus约120美元/年,机构版面议。

5. Litmaps

Litmaps(已收购ResearchRabbit)以引用网络可视化为核心,代表了学术文献发现工具中与Undermind截然不同的产品哲学。

核心优势: 交互式引用网络地图是文献全貌直观呈现的最佳工具——以种子论文为出发点,可视化整个引用生态,节点大小代表引用量,X轴为时间,Y轴为影响力;多维度轴向切换(Momentum、Map Connectivity)提供独特的领域分析视角;文献监控功能持续追踪领域新进展;收购ResearchRabbit后用户规模和数据覆盖都有提升;学术折扣后约2-3美元/月,价格极低。

核心劣势: 发现机制依赖已知文献的引用关系,对于引用网络尚不成熟的新兴领域(或预印本主导的领域),可视化地图的覆盖率有限;没有结构化数据提取;没有自适应迭代搜索逻辑;免费版仅1张地图,功能体验受限;对中文文献同样覆盖极弱。

与Undermind的关键差异: 这是”从已知出发”与”主动覆盖未知”的根本差异。Litmaps依赖用户已知的种子论文,沿引用关系展开发现;Undermind从研究问题描述出发,通过算法迭代主动覆盖相关文献,不需要用户事先知道任何种子论文。对于进入全新陌生领域的研究者,Undermind的主动搜索比Litmaps的”从已知论文延伸”更适合作为起点。

定价参考: 免费版1张地图,Pro约8-10美元/月,学术折扣后约2-3美元/月。

横向对比速览

谁最适合用Undermind

开展系统综述且对召回率有高要求的研究团队是Undermind价值最高的用户群体。在Cochrane Review、循证医学临床实践指南、政策研究报告等对文献覆盖全面性有明确方法论要求的项目中,能够量化”已找到约90%相关文献”并支持继续扩展搜索,是实实在在的方法论竞争力。

进入全新研究方向、没有任何种子论文的研究者。当你第一次涉足一个完全陌生的领域,没有任何可以作为出发点的”已知论文”时,Undermind的自然语言搜索入口(不需要先知道任何文献)比Litmaps(需要种子论文)更适合作为起点,比关键词搜索(需要掌握领域术语)更低摩擦。

跨学科研究者。当研究问题横跨多个学科时,每个学科有不同的核心术语,传统关键词搜索极易漏掉跨学科交叉文献。Undermind的语义理解和迭代策略调整能够自动识别不同学科对同一概念的不同表述,是跨学科文献覆盖效率最高的工具。

需要定期追踪特定研究方向新进展的研究人员。搜索提醒+邻域提醒的组合,是一个高质量的自动化领域情报系统。对于在企业研发、政策咨询或竞争情报岗位上需要持续监控特定技术领域的分析师,这个功能的长期价值极为突出。

不太适合Undermind的情形:

主要研究中文文献的学者——数据库覆盖的现实局限是不可绕过的障碍。需要结构化数据提取(系统综述数据提取阶段)的研究者——这个功能缺口必须靠Elicit或人工补足。需要即时快速搜索的低频用户——2-5分钟等待时间对于临时查阅场景不合适,Semantic Scholar的免费即时搜索更为适用。以质性研究、历史学、文学批评为主要研究方法的学者——领域文献的非标准化特性限制了Undermind的有效性。

关于AI学术搜索工具的一个共同局限

在对Undermind给出任何强烈推荐之前,有一个所有AI学术搜索工具都共同面对的根本性问题值得点明:算法不透明(opaque algorithms)。

Undermind有公开的技术白皮书,这比大多数同类工具透明,但其搜索策略的具体实现细节、覆盖率估算的统计模型,以及LLM相关性判断的具体指令,都不是完全开放的。这意味着:

-

同一个研究问题,在不同时间输入,可能因为底层LLM版本的变化而得到不同结果

-

在某些未充分测试的研究领域,召回率可能显著低于官方基准测试

-

“找到了90%的相关文献”这个数字,其置信区间和统计假设没有独立验证

不列颠哥伦比亚大学图书馆的评测报告和不列颠哥伦比亚大学维基页面上对AI学术工具的集体评估,都将”算法不透明”列为包括Undermind在内的所有同类工具的持续性局限。对于方法论要求严格的系统综述,这意味着AI工具的搜索结果需要与传统数据库的系统检索策略互为补充和验证,而不是简单替代。

Undermind在这个局限上的应对策略——提供白皮书、公开基准测试数据、量化覆盖率估算——在透明度上已经优于大多数竞品,但距离”方法论完全可复现”的系统综述标准,仍有差距需要诚实说明。

最优学术AI工具组合:Undermind在工作流中的位置

基于以上分析,在设计一个系统性文献综述的AI辅助工作流时,Undermind的最优定位如下:

阶段一:主题快速定位(Litmaps)

如果已有1-2篇种子文献,先用Litmaps的引用网络地图获得领域全貌的直观感知。

阶段二:全覆盖系统搜索(Undermind)

以研究问题的自然语言描述为输入,执行深度迭代搜索,获得高召回率的候选文献集合,设置搜索提醒持续监控。

阶段三:证据提取分析(Elicit)

将Undermind找到的候选文献导入Elicit,使用自定义列执行结构化数据提取,完成系统综述的数据层。

阶段四:引用质量核查(Scite)

对关键引用文献进行Smart Citations核查,识别可能已被质疑的结论,强化综述的证据可靠性。

这个四步工作流的总成本:Undermind Pro $16/月 + Elicit Pro $49/月 + Scite Plus $10/月(年付)= 约$75/月,但能覆盖系统综述从全面搜索到证据提取到质量核查的完整需求,远超任何单一工具的能力边界,也远低于雇用额外人工研究助理的成本。